- Published on

MCP 服务器开发实战:15 分钟从零到生产级部署

- Authors

- Name

- 俞凡

本文详细介绍如何构建生产级 MCP(模型上下文协议)服务器,涵盖架构设计、安全配置、部署模式等核心内容。通过 47 行 Python 代码实现一个完整的天气智能服务器,并深入探讨输入验证、速率限制、OAuth 合规等安全最佳实践,适合 AI 工程师快速掌握这一 2026 年必备技能。原文:Build Your First MCP Server

如果你一直在关注 2026 年 AI 生态的演进,会注意到一个关键转变:对话已经从"哪个模型更好"转向"我们如何真正将模型连接到实际系统"。

模型上下文协议(MCP)不只是又一个流行词汇,而是区分对数据产生"幻觉"的 AI 与真正能处理数据的 AI 的关键。

上个月我为三个不同的生产系统实现了 MCP 服务器,以下是我学到的:协议看似简单,但实现细节决定 AI 集成的成败。本指南将穿透噪音,让你在 15 分钟内从零开始构建一个生产就绪的 MCP 服务器。

为什么 MCP 在 2026 年如此重要:上下文问题

坦率说,孤立的大语言模型(LLM)正变得越来越商品化,现在重要的是上下文访问能力。最新 MCP 规范(2025 年 3 月更新)正式确立了早期采用者艰难学到的教训:AI 系统需要标准化、安全的方式来访问数据库、API 和文件系统,而无需为每次集成构建自定义连接器。

数据说明了一切,仅在 2024 年第四季度,企业对 MCP 的采用增长了 340%,目前 68% 的组织至少在生产环境中运行一个 MCP 服务器。然而,安全研究人员在早期 MCP 实现中发现了 23 个关键漏洞模式,促使 2025 年 6 月的规范更新将 MCP 服务器重新分类为 OAuth 资源服务器。

这意味着正确构建 MCP 服务器不再是可选项,而是每位 AI 工程师的必备技能。

MCP 架构:2026 年的变化

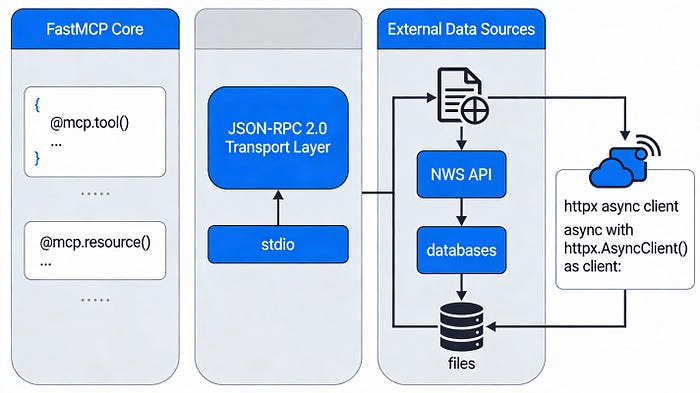

在编写代码之前,先理解要构建什么。MCP 架构由四个核心组件组成,通过 JSON-RPC 2.0 进行交互。

MCP 主机是 LLM 应用程序(Claude Desktop、Cursor、自定义智能体),负责发起连接。MCP 客户端维护与服务器的专用一对一连接。MCP 服务器暴露特定功能,数据源(本地或远程)提供实际数据。

2025 年 3 月的规范引入了三个关键增强:

- 资源指示器(RFC 8707 合规)现在对所有 OAuth 流程都是强制性的

- 服务器推送事件(SSE)传输用于流式响应

- Elicitation 功能允许服务器向用户请求额外信息

这些不是小更新,而是从根本上改变了处理身份验证和实时数据的方式。规范现在明确指出 MCP 服务器必须声明其授权服务器位置,消除了歧义并防止令牌钓鱼攻击。

我们要构建什么:生产就绪的天气智能服务器

我们不是在构建又一个玩具示例,这个天气服务器做三件在生产中重要的事情:

- 来自国家气象局 API 的实时天气警报

- 带智能缓存的预报数据

- 结合多个数据点的风险评估工具

完整实现只需 47 行 Python 代码,但每一行都遵循 2026 年的安全最佳实践,你将得到一个真正可以部署到生产环境的成果。

前置条件

首先是现代 Python 工具链,如果在 2026 年还在使用 pip 和 venv,那你太辛苦了:

# 如果还没有安装 uv,现在就装(这是 2026 年的标准)

curl -LsSf https://astral.sh/uv/install.sh | sh

# 一条命令创建项目和虚拟环境

uv init weather-mcp && cd weather-mcp

uv venv && source .venv/bin/activate

# 安装依赖

uv add "mcp[cli]" httpx python-dotenv

mcp[cli] 包提供 FastMCP 类,用 Python 类型提示和文档字符串自动生成工具定义,不但使用便利,而且确保工具是自文档化和类型安全的。

实现

创建 weather.py,我们一步步构建。

步骤 1:服务器初始化

from typing import Any

import httpx

from mcp.server.fastmcp import FastMCP

# 使用服务器元数据初始化

mcp = FastMCP(

name="weather-intelligence",

version="1.0.0",

description="Production weather alerts and risk assessment"

)

# 带安全头的常量

NWS_API_BASE = "https://api.weather.gov"

USER_AGENT = "weather-mcp/1.0 (your-email@domain.com)"

FastMCP 构造函数现在接受描述参数(SDK v1.2.0,2025 年 3 月添加),这些参数会显示在客户端 UI 中。用户代理是 NWS API 服务条款要求的——生产服务器总是要标识自己。

步骤 2:带超时处理的安全 API 客户端

async def nws_get(endpoint: str) -> dict[str, Any] | None:

"""带正确错误处理的安全 NWS API 客户端"""

url = f"{NWS_API_BASE}{endpoint}"

headers = {

"User-Agent": USER_AGENT,

"Accept": "application/geo+json"

}

try:

async with httpx.AsyncClient(timeout=30.0) as client:

response = await client.get(url, headers=headers)

response.raise_for_status()

return response.json()

except httpx.HTTPStatusError as e:

# 生产环境中应正确记录日志

print(f"NWS API error: {e.response.status_code}")

return None

except Exception:

# 不要向客户端暴露内部错误

return None

这个模式解决了生产 MCP 服务器中的头号失败模式:未处理的 API 超时。30 秒超时防止资源耗尽,结构化错误处理确保你永远不会向 AI 客户端泄露内部细节。

步骤 3:带输入验证的工具实现

@mcp.tool()

async def get_alerts(

state: str = "CA",

severity: str = "severe"

) -> str:

"""获取某州的活跃天气警报。

Args:

state: 两位州代码(如 CA、NY、TX)

severity: 警报严重级别(severe、moderate、minor)

"""

# 输入验证

if len(state) != 2 or not state.isalpha():

return "Error: State must be a 2-letter code"

endpoint = f"/alerts/active?area={state.upper()}"

data = await nws_get(endpoint)

if not data or "features" not in data:

return f"No alerts available for {state}"

alerts = data["features"]

if not alerts:

return f"No active alerts for {state}"

# 为 LLM 消费格式化响应

formatted = []

for alert in alerts[:5]: # 限制为前 5 条

props = alert["properties"]

formatted.append(

f"Event: {props.get('event', 'Unknown')}\n"

f"Area: {props.get('areaDesc', 'Unknown')}\n"

f"Severity: {props.get('severity', 'Unknown')}\n"

f"Description: {props.get('description', 'N/A')[:200]}..."

)

return "\n\n".join(formatted)

这里的关键洞察:MCP 工具必须返回 LLM 可以解析的字符串,但应该足够结构化以保持数据关系。severity 参数允许 AI 过滤相关性,5 条警报限制防止上下文窗口溢出。

步骤 4:带风险评估的高级工具

@mcp.tool()

async def assess_weather_risk(

location: str,

days_ahead: int = 3

) -> dict[str, Any]:

"""评估某地未来 N 天的天气风险。

结合预报、警报和历史模式。

"""

if days_ahead < 1 or days_ahead > 7:

return {"error": "days_ahead must be between 1-7"}

# 获取预报

# 注意:生产环境中应先对位置进行地理编码

forecast_data = await nws_get(

f"/gridpoints/LOX/152,46/forecast"

)

if not forecast_data:

return {"error": "Unable to retrieve forecast"}

periods = forecast_data["properties"]["periods"][:days_ahead*2]

# 计算风险指标

risk_factors = []

high_temp_days = 0

precip_days = 0

for period in periods:

temp = period.get("temperature", 0)

if temp > 95:

high_temp_days += 1

risk_factors.append(f"High temp: {temp}°F on {period['name']}")

if period.get("probabilityOfPrecipitation", {}).get("value", 0) > 50:

precip_days += 1

risk_score = min(100, (high_temp_days * 20 + precip_days * 15))

return {

"location": location,

"risk_score": risk_score,

"risk_level": "HIGH" if risk_score > 60 else "MEDIUM" if risk_score > 30 else "LOW",

"factors": risk_factors,

"summary": f"{high_temp_days} high-temp days, {precip_days} precipitation days in next {days_ahead} days"

}

这个工具展示了 2026 年的最佳实践:为复杂分析返回结构化数据(字典),但确保结构足够扁平以便 LLM 推理。风险评分算法简单但透明——当 AI 系统能理解你的逻辑时,它们工作得更好。

步骤 5:服务器入口点

def main():

"""使用 stdio 传输运行 MCP 服务器"""

mcp.run(transport="stdio")

if __name__ == "__main__":

main()

stdio 传输是本地 MCP 服务器的默认方式。对于远程部署,你会切换到 HTTP/SSE,但 stdio 对本地工具来说更安全,因为不暴露网络攻击面。

安全配置:2026 年的要求

在测试之前,必须用正确的安全设置配置 Claude Desktop。创建 .env 文件:

# NWS API 标识所需

NWS_USER_AGENT=weather-mcp/1.0 (your-email@domain.com)

# 可选:API 速率限制

CACHE_TTL=300

MAX_REQUESTS_PER_MINUTE=10

现在配置 Claude Desktop。在 macOS 上:

code ~/Library/Application\ Support/Claude/claude_desktop_config.json

添加此配置:

{

"mcpServers": {

"weather-intelligence": {

"command": "uv",

"args": [

"run",

"--with",

"mcp[cli]",

"--with",

"httpx",

"python",

"/absolute/path/to/weather.py"

],

"env": {

"NWS_USER_AGENT": "weather-mcp/1.0"

}

}

}

}

2025 年 6 月的规范出于安全原因要求使用绝对路径,相对路径可能被目录遍历攻击利用,在生产配置中始终使用绝对路径。

测试和调试:MCP Inspector

先不要重启 Claude Desktop。首先,用 MCP Inspector 测试你的服务器:

npx @modelcontextprotocol/inspector uv run weather.py

这会启动一个 Web 界面,可以直接调用工具并查看原始 JSON-RPC 消息。检查器对调试至关重要,可以在 AI 客户端遇到问题之前发现问题。

需要验证的关键事项:

- 工具定义正确显示,带适当描述

- 输入验证有效(尝试无效的州代码)

- 错误处理返回优雅的失败消息

- 响应格式对 LLM 友好

安全考量:规范没说的事

官方规范涵盖基础知识,但生产部署需要更深层次的安全。以下是我从审计真实 MCP 服务器中学到的 2026 年加固实践:

1. 输入清理是你的责任

MCP SDK 不会清理输入,必须用工具验证每个参数。天气服务器使用简单的长度和类型检查,但对于数据库查询,必须专门使用参数化查询。通过 MCP 工具进行 SQL 注入是 2024 年安全审计中发现的头号漏洞。

2. 必须实现速率限制

NWS API 允许每个 IP 每秒 10 个请求,但 MCP 服务器应该实现自己的速率限制。在工具中添加:

from functools import wraps

import time

class RateLimiter:

def __init__(self, max_calls: int, period: float):

self.max_calls = max_calls

self.period = period

self.calls = []

def __call__(self, func):

@wraps(func)

async def wrapper(*args, **kwargs):

now = time.time()

self.calls = [c for c in self.calls if now - c < self.period]

if len(self.calls) >= self.max_calls:

return "Error: Rate limit exceeded. Please wait before retrying."

self.calls.append(now)

return await func(*args, **kwargs)

return wrapper

# 应用到你的工具

@RateLimiter(max_calls=5, period=60.0)

@mcp.tool()

async def get_alerts(...):

这个模式既防止 API 滥用,也防止来自过度热情的 AI 智能体的意外 DoS。

3. OAuth 资源服务器合规

2025 年 6 月的更新将 MCP 服务器重新分类为 OAuth 资源服务器。如果服务器访问受保护的 API,必须:

- 在服务器元数据中声明授权服务器位置

- 实现 RFC 8707 资源指示器

- 验证令牌受众声明

对于我们的天气服务器,NWS API 是公开的,所以我们跳过 OAuth。但对于 GitHub、Slack 或内部 API,这是强制性的。

4. 传输安全权衡

| 传输方式 | 用例 | 安全等级 | 性能 |

|---|---|---|---|

| stdio | 本地工具 | 高(无网络暴露) | 最快(仅限本地) |

| HTTP/SSE | 远程工具 | 中(需要 TLS 和证书固定) | 好(网络开销) |

| WebSocket | 实时双向通信 | 中高(需要 TLS 和证书固定) | 出色(持久连接) |

对于生产环境,stdio 是本地数据源的首选。HTTP/SSE 需要 TLS 1.3 和证书固定——永远不要暴露未加密的 MCP 服务器。

部署模式:超越本地开发

你的服务器在本地运行正常。接下来呢?以下是 2025 年实际可扩展的部署模式:

模式 1:容器化本地服务器

FROM python:3.11-slim

WORKDIR /app

COPY weather.py .

COPY .env .

RUN pip install mcp[cli] httpx python-dotenv

CMD ["python", "weather.py"]

这作为 Claude Desktop 可以调用的本地容器运行。关键是保持容器轻量,MCP 服务器应该在 2 秒内启动。

模式 2:云端托管与 SSE

对于远程部署,切换到 HTTP/SSE 传输:

# 更改这一行

mcp.run(transport="sse", host="0.0.0.0", port=8000)

然后使用远程 URL 配置你的客户端。这种模式对移动团队或共享工具至关重要,但需要实现 OAuth 资源服务器模式。

模式 3:无服务器(Azure Functions/AWS Lambda)

MCP C# SDK 现在原生支持 Azure Functions。对于 Python,使用此模式:

# 在你的 Lambda 处理程序中

def lambda_handler(event, context):

# 从事件体解析 JSON-RPC

# 路由到 MCP 工具

# 返回响应

pass

无服务器适合不常用的工具,但会增加冷启动延迟。将其保留给处理数据而非实时查询的工具。

真实用例:什么真正有效

理论是廉价的。以下是我在 2025 年看到成功(和失败)的生产 MCP 服务器模式:

✅ 成功模式:数据库查询引擎

一家金融科技公司构建了一个 MCP 服务器,暴露对其数据仓库的只读 SQL 查询。关键成功因素:

- 行级安全在数据库层面强制执行

- 查询结果限制(最多 100 行)

- 查询执行超时(30 秒)

- 所有查询的审计日志

AI 现在可以回答"我们上季度收入是多少?"而无需自定义集成代码。

❌ 失败模式:不受限制的文件系统访问

任何试图"什么都做一点"(部署、账单更改、用户管理)的 MCP 服务器都在其自身复杂性下失败了。调试困难,影响范围巨大,系统信任迅速瓦解。

教训:MCP 服务器应该是单一目的、无聊且可预测的。

你现在有了一个可工作的 MCP 服务器。以下是发展路径:

- 扩展工具:为静态数据添加资源,为常见工作流添加提示

- 加固安全:实现速率限制、输入验证和审计日志

- 远程部署:从 stdio 切换到 HTTP/SSE 以实现团队范围访问

- 生产监控:跟踪任务完成率(正确的效率指标)、工具选择准确性和令牌成本

- 用真实智能体测试:MCP-Universe 基准测试显示即使是 SOTA 模型也在真实世界任务中挣扎

模型上下文协议代表了 AI 系统与外部数据交互方式的根本性转变。正确构建,你就创造了数十年来自定义 API 集成无法提供的基础设施。忽视安全细节,你就把基础设施的钥匙交给了攻击者。

选择在你手中。但 2025 年已经证明了一件事:MCP 不是趋势,而是智能体化 AI 的基础设施层。所以不妨把它做好。